V4来了,算力霸权松动了,谁还在拼芯片?

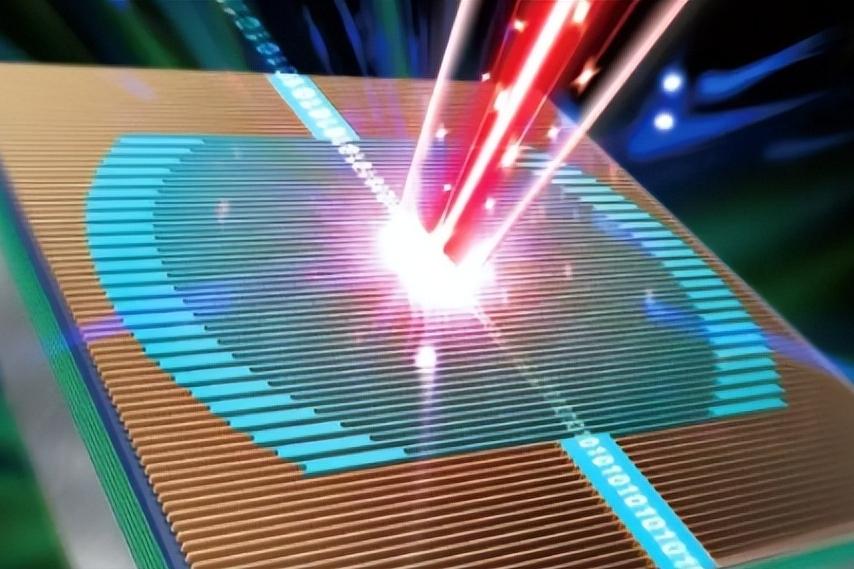

最近DeepSeek发了个新模型V4,不是啥新闻发布会,是实实在在跑通了——用华为昇腾950PR芯片,原生跑,没改模型结构,也没靠英伟达H800偷偷摸摸训练完再转。它参数1.6万亿,但真正干活的只有490亿激活参数,像大脑里只调用需要的那部分神经元,其余全“休眠”。不是省电,是压根不浪费。

黄仁勋四月中旬在播客里说“horrible outcome”,没点名,但时间太巧了——V4适配CANN框架的消息4月24日发,CUDA迁移不是翻译代码,是重写了内存调度、算子融合、图编译三层逻辑。开发者试了几天就说:写CANN比写CUDA快,报错少,部署快,连小公司都能搭起推理服务。

斯坦福AI指数报告写得明明白白:中美AI投入比23:1。美国砸了2859亿,中国这边没公布总数,但DeepSeek百人团队,三年推三代模型,V2到V4只隔6个月。不是人多,是高校每年计算机专业毕业百万以上,练手场景多——微信支付宝每天超10亿笔交易,真实世界噪音大、脏数据多、响应要快,逼出来的压缩能力,国外实验室模拟不出来。

它开源用Apache 2.0协议,不是为了“大方”,是让中东、俄罗斯、东南亚公司直接拿去用,不用申请许可,不走美元结算,也不用担心API被突然封。昇腾芯片+V4+CANN,一整套闭环落地商用,连电力成本都算进去了——中国西部风电便宜,长周期训模型不心疼。

GPT-5.5 Pro现在收180美元每百万token,V4-Flash只要0.279美元。不是降价,是底层算法逻辑变了:不靠暴力算,靠精准索引知识图谱。美国还在堆显存、扩集群,V4已经把“该算哪一段”变成了一道符号逻辑题。

白宫一边说“工业盗窃”,一边加速全球开发者转向V4。不是大家讨厌CUDA,是第一次发现:不用它,也能跑得更稳、更便宜、更快上线。

黄仁勋怕的不是芯片卖不动,是他突然听到了一种新声音——原来智能,真能从约束里长出来,而不是从服务器机房里堆出来。

V4不是来抢市场的。它是来改规则的。

它已经跑起来了。