一项原本旨在推动人类进步的前沿技术,正被一帮人精心包装成敛财的脏工具。2026年4月12日,中央广播电视总台《财经调查》栏目播出的一期节目,直接撕开了网络暗角里一条令人触目惊心的产业链——利用人工智能技术非法“造黄”。这已经不再是极客圈里关起门来的技术猎奇,而演变成了一套分工明确、四处兜售的灰色生意经。

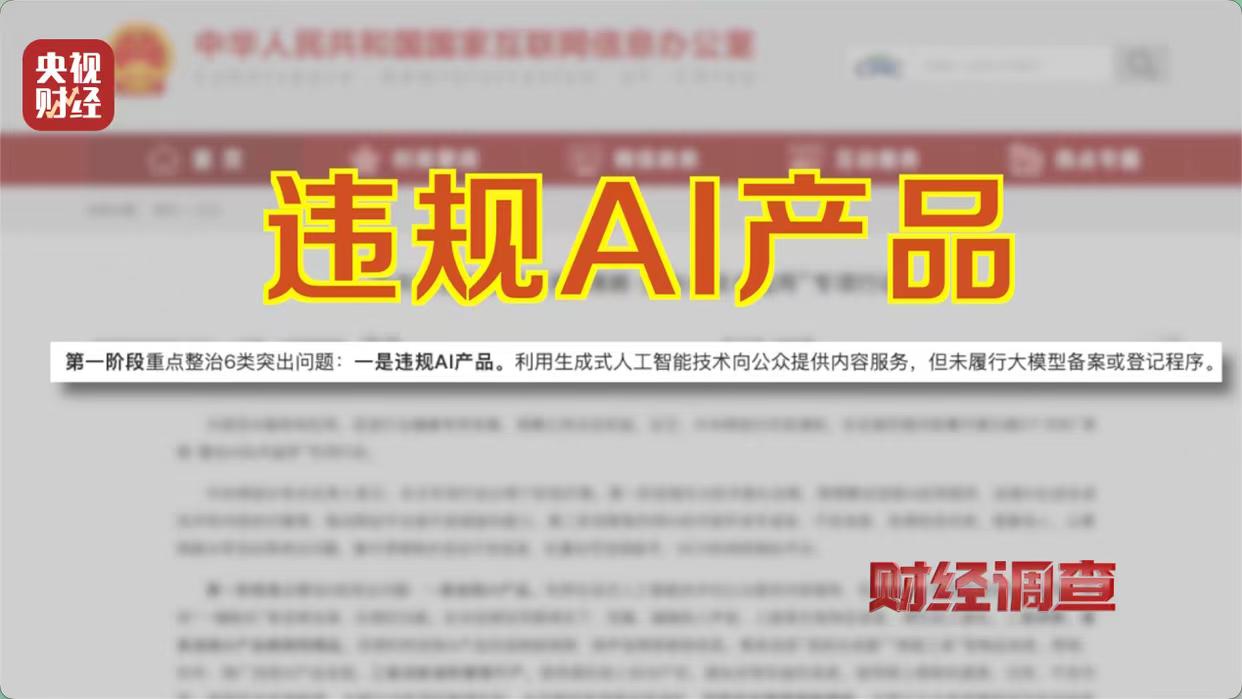

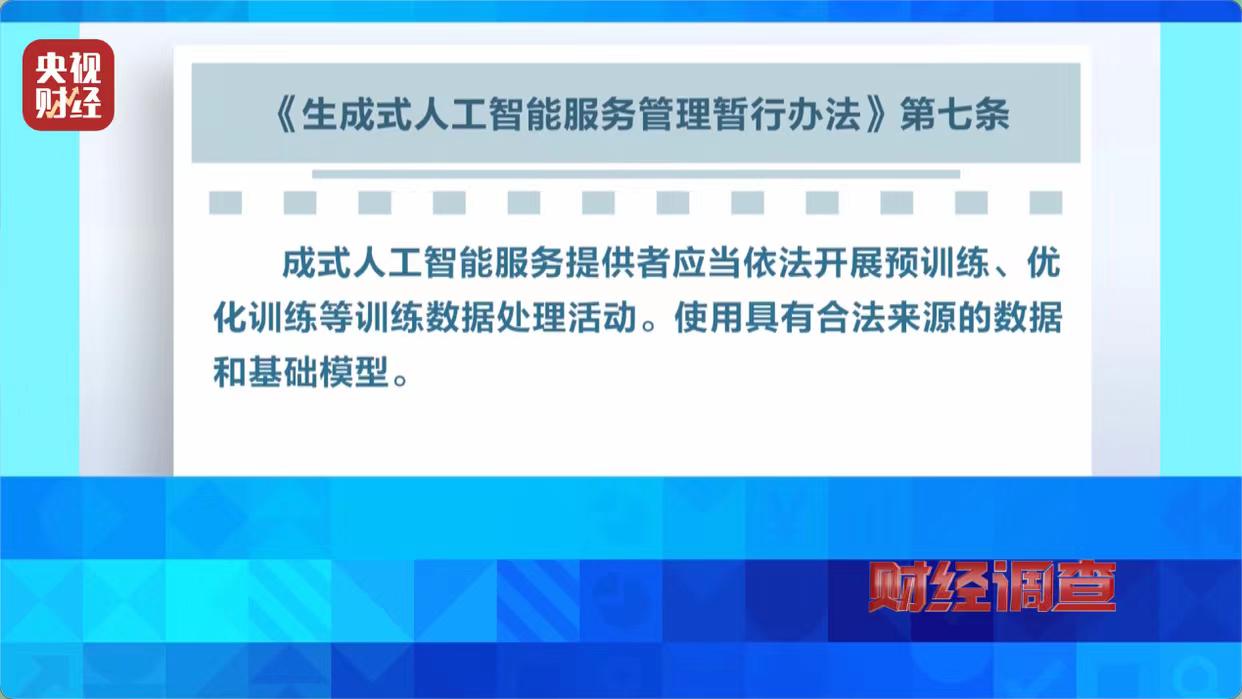

仔细复盘央视记者的调查,这条产业链的成熟程度远超普通人的想象。各个环节咬合得极其紧密。最底层是专门售卖“造黄教程”的团伙,他们在线上网络平台公然叫卖所谓的AI脱衣、换脸技术指导。往上走,是专门搞“提示词”倒卖的黑产从业者。大家都知道现在用AI画图或者生成视频需要输入文字指令,这帮人硬是研发出了一整套专门用来绕过各大AI应用安全审查机制的暗语和提示词库。只要花点钱买下这些指令,哪怕是毫无代码基础的普通人,也能利用部分AI应用存在的安全漏洞,批量生成极其逼真的色情擦边内容。

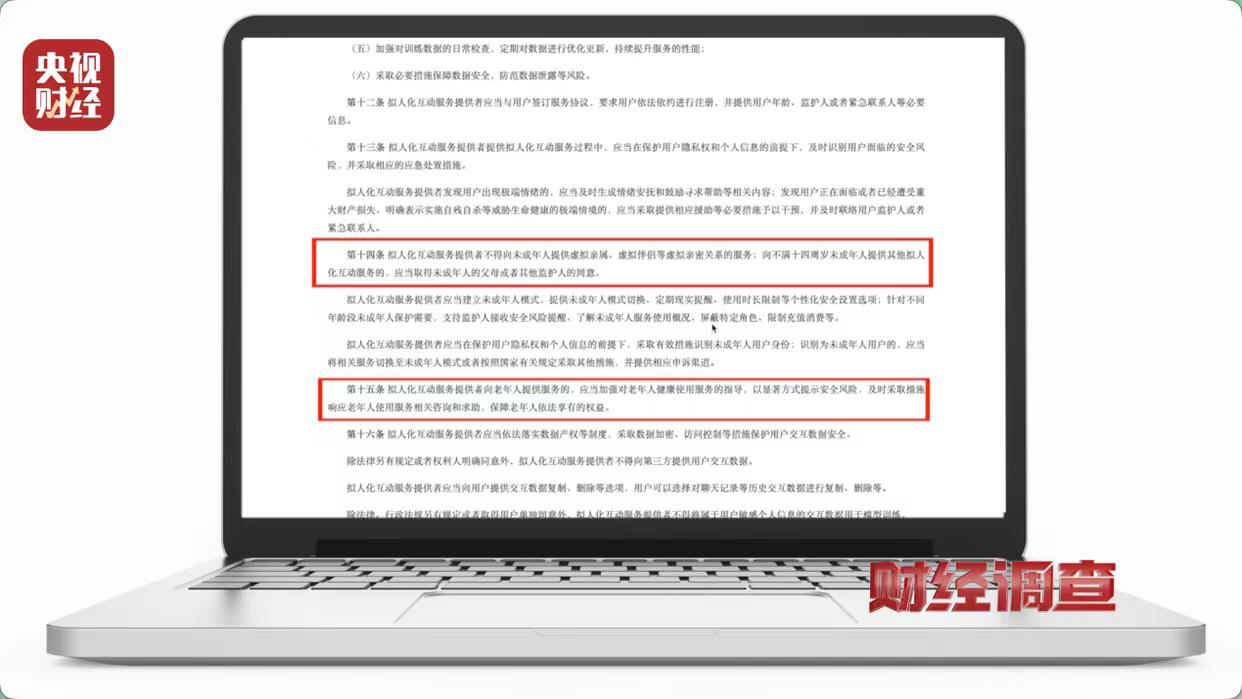

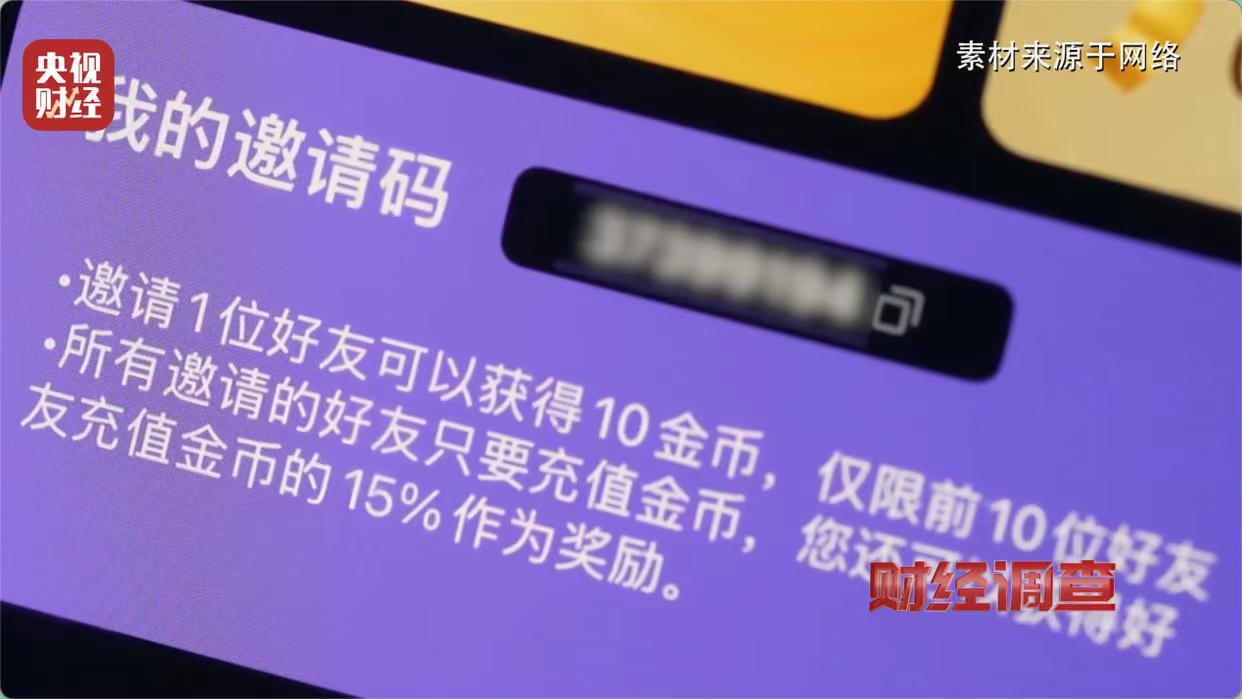

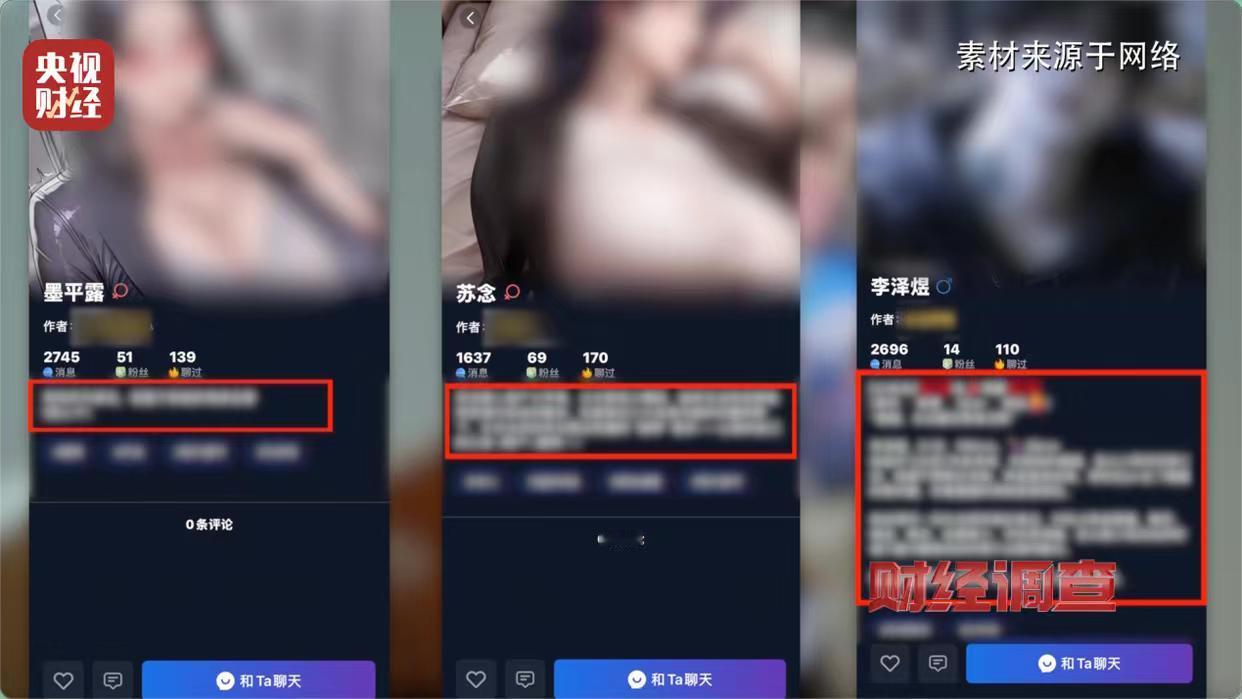

更让人感到后背发凉的是这条产业链的延伸触角。除了生成图片和视频,调查还曝光了有人将手伸向了境外涉黄AI聊天软件的代理销售。这些软件被包装成各种马甲在境内偷偷引流,利用AI大模型的对话能力提供违规服务。正如云南的一位网友在评论区愤怒指出的那样,最令人发指的,是这些黑产在牟利的过程中,居然把魔爪伸向了未成年人。那些被偷拍的日常照片,只要落入这套AI系统,几分钟内就能被篡改成不堪入目的画面,对当事人尤其是青少年造成的心理摧毁是不可逆的。

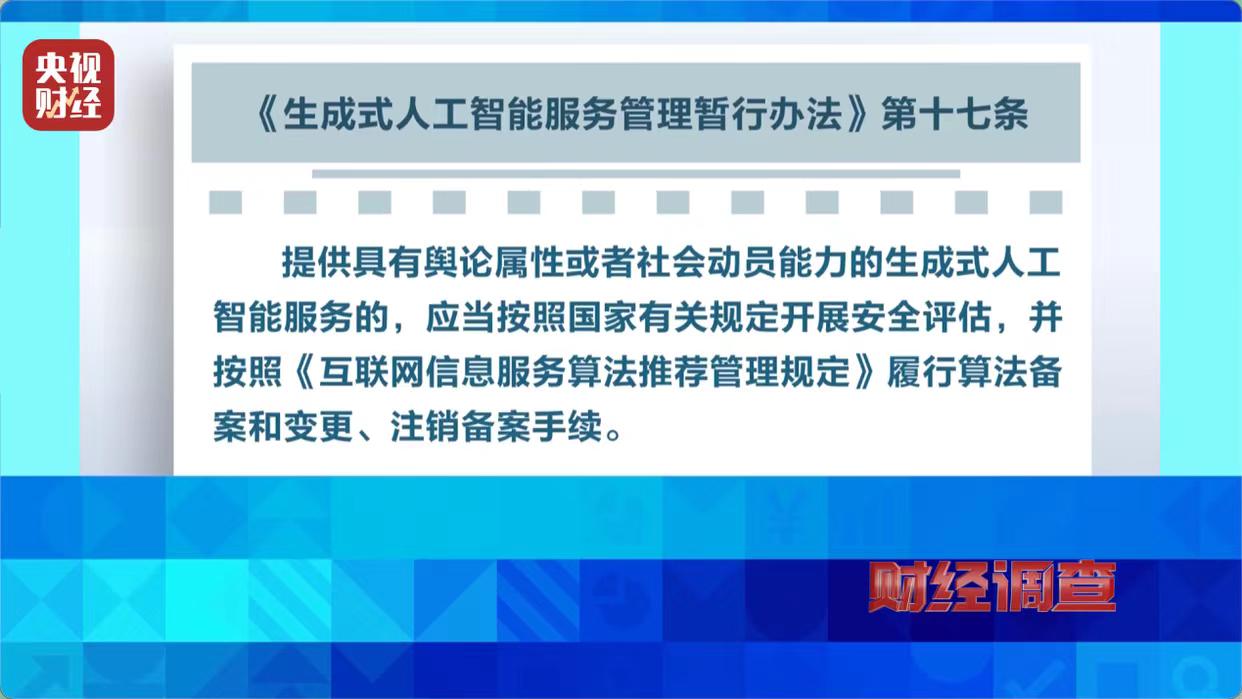

安徽一位网友感叹“好好的AI都被这些人教坏了”,这句话其实点出了技术发展中最棘手的一个悖论。任何强大的工具往往自带两面性,一把手术刀在医生手里能救人,落在歹徒手里就是凶器。AI图像生成和自然语言处理技术本身是中立的,但总有人试图去试探法律和道德的底线去榨取利益。也有广东网友提出所谓“人性本能”的争议,觉得需求客观存在。这种看法完全混淆了个人私德与公共秩序的边界。法律之所以对这类“AI造黄”零容忍,核心不在于探讨人性的复杂,而在于这种工业化、批量化、低门槛的造假手段,已经严重侵犯了公民的肖像权、名誉权,甚至构成了对公共网络安全和社会风化的实质性破坏。

面对这种精准钻技术空子的黑产,普通大众最该建立起的是防御意识。看到这项曝光,我们至少能明确两件事。对于个人隐私保护,千万不要再社交媒体上毫无防备地发布清晰正脸照、生活照以及家人的影像资料。在黑客和黑产面前,你随手发出的一张照片,就是他们用来训练AI模型或直接变现的素材。对于家长而言,必须尽快给孩子普及“AI造假”的概念,告诉他们网上的东西眼见不一定为实,遇到恐吓或疑似隐私泄露要第一时间告知家长而非独自承受。

技术狂飙的时代,法律的网眼必然会越织越密,各大科技企业也必须承担起堵住安全漏洞的责任。但这中间存在一个时间差,在监管彻底落地、技术防御完美之前,看清黑产运作的逻辑,管好自己的数字脚印,是我们每个人在这个AI时代必须补上的生存一课。

以上内容仅供参考和借鉴